Nvidia a discrètement construit une division réseau massive qui rivalise avec son activité principale de puces, tirée par la croissance explosive de l’intelligence artificielle. Bien que la société soit surtout connue pour ses GPU, son segment de réseautage de centres de données est devenu une source de revenus critique et en expansion rapide, dépassant les 31 milliards de dollars de revenus annuels.

L’essor des réseaux d’IA

L’incursion de Nvidia dans les réseaux a commencé en 2020 avec l’acquisition de Mellanox pour 7 milliards de dollars, une décision qui semble désormais prémonitoire. Les technologies de mise en réseau de l’entreprise – notamment NVLink, InfiniBand, Spectrum-X et les optiques co-packagées – sont essentielles à la création d’« usines IA », des centres de données spécialisés optimisés pour la formation de modèles d’IA. Au cours du seul trimestre dernier, la division a généré un chiffre d’affaires de 11 milliards de dollars, soit une augmentation de 267 % d’une année sur l’autre.

Cette croissance dépasse celle des géants des réseaux établis : selon les analystes de Zacks Investment Research, le chiffre d’affaires des réseaux de Nvidia en un seul trimestre dépasse désormais l’ensemble des activités de réseaux de Cisco pour l’année. Malgré ce succès, le segment reçoit moins d’attention du public que les divisions puces ou jeux de Nvidia.

Pourquoi c’est important

L’expansion de Nvidia dans le domaine des réseaux n’est pas seulement une question de diversification ; il s’agit de contrôler l’ensemble de la pile d’infrastructure d’IA. En intégrant les GPU aux réseaux haut débit requis pour la formation en IA, Nvidia peut offrir une solution complète et optimisée à ses clients. Cette intégration verticale constitue un différenciateur clé, dans la mesure où Nvidia vend la pile complète par l’intermédiaire de partenaires plutôt que de composants individuels.

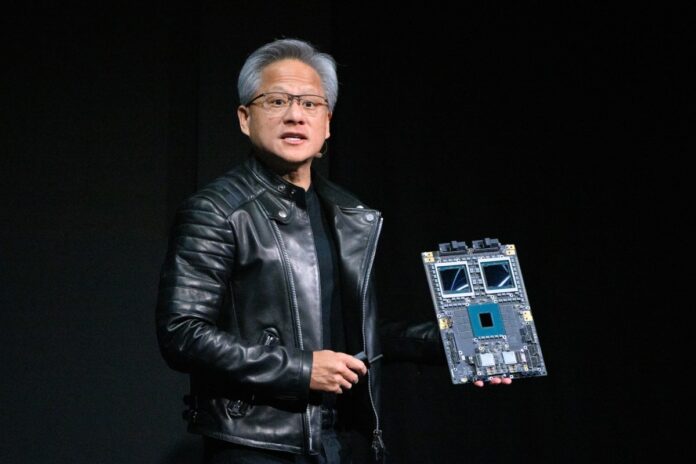

Comme l’explique Kevin Deierling, vice-président senior des réseaux de Nvidia, le PDG de l’entreprise, Jensen Huang, a reconnu très tôt que le centre de données est désormais l’unité fondamentale de l’informatique, rendant la mise en réseau aussi essentielle que les puces elles-mêmes.

Domination du Full-Stack

Nvidia ne vend pas seulement du matériel ; il vend un système entièrement intégré. Cette approche permet à Nvidia de tirer davantage de valeur du boom de l’IA et d’enfermer les clients dans son écosystème. La société a récemment dévoilé la plate-forme Rubin, comprenant six nouvelles puces conçues pour les « supercalculateurs IA », ainsi que des avancées en matière de stockage de mémoire de contexte d’inférence et de commutateurs photoniques Ethernet Spectrum-X.

“Ce n’est plus un périphérique pour connecter l’imprimante… C’est fondamental pour l’ordinateur. Autrefois, on avait ce qu’on appelait la doublure arrière à l’intérieur de l’ordinateur. Aujourd’hui, le réseau est la doublure arrière de l’usine IA, et c’est super important.”

— Kevin Deierling, vice-président principal des réseaux de Nvidia

L’expansion silencieuse de Nvidia dans le domaine des réseaux la positionne comme une force dominante à l’ère de l’IA, non seulement en tant que fournisseur de puces, mais aussi en tant que fournisseur de l’ensemble de l’infrastructure nécessaire pour alimenter la prochaine génération d’informatique. Cette décision stratégique garantit la pertinence et la rentabilité à long terme de Nvidia sur un marché en évolution rapide.