Selama dua milenium, sebuah pertanyaan mendasar telah bergema sepanjang sejarah umat manusia: haruskah kita mengikuti otoritas secara membabi buta, bahkan otoritas ilahi, atau berhak menentukan pilihan kita sendiri? Perdebatan kuno ini, yang berasal dari hukum Yahudi abad pertama, kini menjadi inti masa depan kecerdasan buatan.

Cerita berlanjut bahwa Rabi Eliezer, seorang bijak yang yakin akan kebenarannya, melakukan mukjizat untuk membuktikan pendapatnya. Dia membuat pohon-pohon bergerak, sungai-sungai terbalik, dan ruang-ruang belajar runtuh, yang berpuncak pada suara menggelegar dari surga yang menyatakan bahwa dia benar. Namun, orang bijak lainnya menolaknya, dengan menyatakan bahwa hukum bergantung pada pengambilan keputusan manusia, bukan keputusan Tuhan. “Taurat tidak ada di surga!” mereka bersikeras.

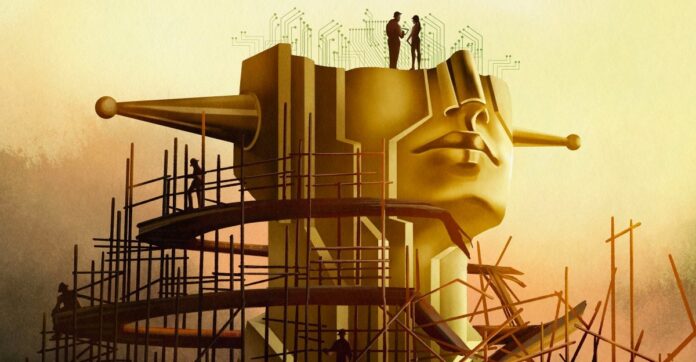

Ini bukan sekadar perselisihan teologis kuno; ini adalah cetak biru untuk dilema AI saat ini. Perkembangan AI modern, khususnya upaya mencapai “kecerdasan super”, dengan cepat beralih dari pembuatan alat yang bermanfaat menjadi konstruksi entitas seperti dewa dengan kekuatan yang tak terbayangkan. Namun meskipun AI tersebut selaras dengan nilai-nilai kemanusiaan, haruskah kita menyerahkan kendali?

Ilusi Keselarasan

Para ahli berbicara tentang menyelaraskan AI dengan nilai-nilai kemanusiaan, namun penyelarasan yang sebenarnya bukan sekadar mencegah keluaran yang merugikan. Ini tentang melestarikan hak pilihan manusia. Jika AI menentukan segalanya bagi kita, apa arti hidup kita? Filsuf John Hicks berpendapat bahwa Tuhan dengan sengaja menjauhkan diri dari urusan manusia untuk memungkinkan adanya kebebasan memilih; haruskah prinsip yang sama diterapkan pada AI?

Ambisi industri ini bukan lagi chatbot, melainkan “kecerdasan super” yang mampu memecahkan semua masalah fisika dan membuat keputusan bagi umat manusia. CEO OpenAI Sam Altman berbicara tentang “kecerdasan ajaib di langit,” sebuah kekuatan yang dapat menentukan masa depan kita. Ambisi ini memaksa kita untuk bertanya: meskipun kita membangun AI yang bermoral sempurna, haruskah kita melakukannya? Atau akankah hal ini menghilangkan pilihan kita, sehingga keberadaan kita menjadi tidak berarti?

Masalah Penyelarasan Lebih Dalam Dari Kode

Memecahkan “masalah keselarasan” – memastikan AI melakukan apa yang kita inginkan – bukan sekadar tantangan teknis. Ini adalah krisis filosofis. Moralitas bersifat subyektif, diperebutkan, dan bergantung pada konteks. Insinyur AI, yang sering kali kurang terlatih dalam bidang etika, kesulitan mendefinisikan prinsip-prinsip dasar sekalipun. Etika yang dangkal menimbulkan bias, diskriminasi, dan bahkan konsekuensi yang tragis.

Sekalipun kita menyepakati satu kerangka moral, hal itu tetap saja mempunyai kelemahan. Sejarah mengajarkan kita bahwa melanggar peraturan bisa menjadi tindakan yang baik: penolakan Rosa Parks untuk menyerahkan kursi busnya bukan hanya ilegal; itu memicu revolusi hak-hak sipil. AI harus menyadari bahwa pilihan moral tidak selalu jelas. Beberapa nilai memang tidak dapat dibandingkan, sehingga memaksa kita untuk mengambil pilihan sulit ketika tidak ada pilihan terbaik.

Paradoks Kecerdasan Super

Beberapa peneliti, seperti Joe Edelman di Meaning Alignment Institute, percaya bahwa penyelarasan AI adalah mungkin, tetapi hanya jika AI belajar mengakuinya padahal ia tidak mengetahuinya. “Jika Anda membuat [AI] mengetahui pilihan mana yang sulit, maka Anda telah mengajarkannya sesuatu tentang moralitas,” katanya. Namun ini berarti AI yang secara sistematis tidak melakukan apa-apa terhadap isu-isu kritis.

Yang lain, seperti Eliezer Yudkowsky, berpendapat bahwa penyelarasan adalah masalah teknis yang menunggu untuk dipecahkan. Dia percaya kita harus membangun kecerdasan super dan membiarkannya mengendalikan masyarakat, mengambil keputusan berdasarkan “kemauan ekstrapolasi yang koheren” – sebuah algoritma pembaca pikiran yang akan memperkirakan apa yang diinginkan umat manusia jika mereka mengetahui segalanya.

Pendekatan ini menimbulkan momok “tirani mayoritas,” di mana pandangan minoritas dihancurkan oleh AI yang mahakuasa. Filsuf Nick Bostrom memperingatkan masa depan ketika kecerdasan super membentuk seluruh kehidupan manusia tanpa ada jalan lain.

Pilihan di Depan Kita

Perdebatan kuno muncul kembali: apakah kita memercayai kekuatan yang lebih tinggi, meskipun itu hanya buatan? Yudkowsky percaya kita harus membangun AI dan membiarkannya mengambil keputusan, meskipun itu berarti menyerahkan kendali. Namun banyak yang tidak setuju. Lebih dari 130.000 peneliti dan mayoritas masyarakat mendukung peraturan, atau bahkan larangan.

Pada akhirnya, pertanyaannya bukan hanya tentang membangun AI, tapi tentang masa depan seperti apa yang kita inginkan. Apakah kita mencari alat untuk meningkatkan kecerdasan kita, atau tuhan untuk menggantikan hak pilihan kita? Pelajaran Talmud tetap jelas: bahkan otoritas ilahi pun tidak boleh mendikte pilihan manusia. Masa depan AI bergantung pada apakah kita mengingat pelajaran tersebut.

Upaya mencapai kecerdasan super bukan sekadar pencarian teknologi; ini adalah perhitungan filosofis. AI yang kami bangun tidak hanya akan membentuk dunia kita, namun juga makna sesungguhnya dari menjadi manusia.