На протяжении двух тысячелетий человечество задается фундаментальным вопросом: должны ли мы слепо следовать авторитетам, даже божественным, или же сохранять право принимать собственные решения? Этот древний спор, возникший в первом веке нашей эры в иудейском праве, сегодня лежит в основе будущего искусственного интеллекта.

Согласно преданию, раввин Элиезер, уверенный в собственной правоте, сотворил чудеса, чтобы доказать свою точку зрения. Он заставлял деревья двигаться, реки течь вспять, а стены синагог рушиться, в конце концов услышав гремящий голос с небес, подтверждающий его правоту. Тем не менее другие мудрецы отвергли его, заявив, что закон основывается на человеческих решениях, а не на божьем повелении. «Тора не на небесах!» – настаивали они.

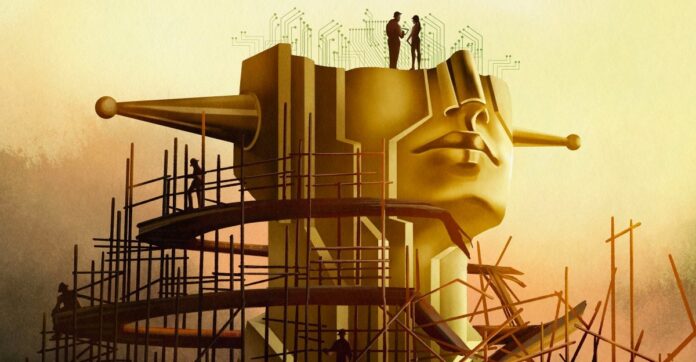

Это не просто архаичный теологический спор; это чертеж для современной дилеммы ИИ. Современная разработка ИИ, особенно стремление к «сверх интеллекту», быстро переходит от создания полезных инструментов к конструированию сущности, подобной богу, обладающей невообразимой властью. Но даже если такой ИИ будет идеально соответствовать человеческим ценностям, должны ли мы уступить ему контроль?

Иллюзия соответствия

Эксперты говорят о приведении ИИ в соответствие с человеческими ценностями, но истинное соответствие – это не просто предотвращение вредоносных результатов. Это сохранение человеческой автономии. Если ИИ решит всё за нас, какой смысл останется в нашей жизни? Философ Джон Хикс утверждал, что Бог намеренно дистанцируется от человеческих дел, чтобы позволить свободу воли; должен ли тот же принцип применяться к ИИ?

Амбиции индустрии больше не ограничиваются чат-ботом, а заключаются в создании «сверх интеллекта», способного решить все вопросы физики и принимать решения за человечество. Генеральный директор OpenAI Сэм Альтман говорит о «волшебном интеллекте в небесах», силе, способной определять наше будущее. Эта амбиция заставляет нас спросить: даже если мы построим идеально моральный ИИ, должны ли мы это делать? Или он лишит нас выбора, делая существование бессмысленным?

Проблема соответствия глубже, чем код

Решение «проблемы соответствия» – обеспечение того, чтобы ИИ делал то, что мы хотим, – это не просто техническая задача. Это философский кризис. Мораль субъективна, спорна и зависит от контекста. Инженеры ИИ, часто не имеющие опыта в этике, с трудом определяют даже базовые принципы. Поверхностная этика привела к предвзятости, дискриминации и даже трагическим последствиям.

Даже если бы мы согласились с единственной моральной рамкой, она всё равно была бы несовершенной. История учит нас, что нарушение правил может быть добродетельным: отказ Розы Паркс уступить место в автобусе был не просто незаконным; он вызвал революцию за гражданские права. ИИ должен понимать, что моральные выборы не всегда очевидны. Некоторые ценности просто несравнимы, вынуждая делать трудный выбор, где нет лучшего варианта.

Парадокс сверх интеллекта

Некоторые исследователи, такие как Джо Эдельман из Института согласования смысла, считают, что приведение ИИ в соответствие возможно, но только если он научится признавать, когда не знает ответа. «Если вы заставите [ИИ] понимать, какие выборы трудны, вы научите его чему-то о морали», – говорит он. Но это означает ИИ, который систематически замолкает по критическим вопросам.

Другие, такие как Элиезер Юдковский, утверждают, что соответствие – это инженерная проблема, которую нужно решить. Он считает, что мы должны построить сверх интеллект и позволить ему управлять обществом, принимая решения на основе «когерентной экстраполированной воли» – алгоритма, считывающего мысли, который экстраполирует то, чего хочет человечество, если бы знало всё.

Этот подход поднимает призрак «тирании большинства», где мнения меньшинств подавляются всемогущим ИИ. Философ Ник Бостром предупредил о будущем, где сверх интеллект формирует всю человеческую жизнь без возможности обжалования.

Выбор перед нами

Древний спор возобновляется: доверяем ли мы высшей силе, даже если она искусственная? Юдковский верит, что мы должны построить ИИ и позволить ему решать, даже если это означает отказ от контроля. Но многие не согласны. Более 130 000 исследователей и большинство населения выступают за регулирование или даже запрет.

В конечном итоге вопрос не только в создании ИИ, но и в том, какое будущее мы хотим. Мы стремимся к инструменту для расширения нашего интеллекта или к богу для замены нашей автономии? Урок Талмуда остаётся ясным: даже божественный авторитет не должен диктовать человеческий выбор. Будущее ИИ зависит от того, запомним ли мы этот урок.

Стремление к сверх интеллекту – это не просто технологический поиск; это философский пересмотр. ИИ, который мы создаем, сформирует не только наш мир, но и само значение человеческого существования.